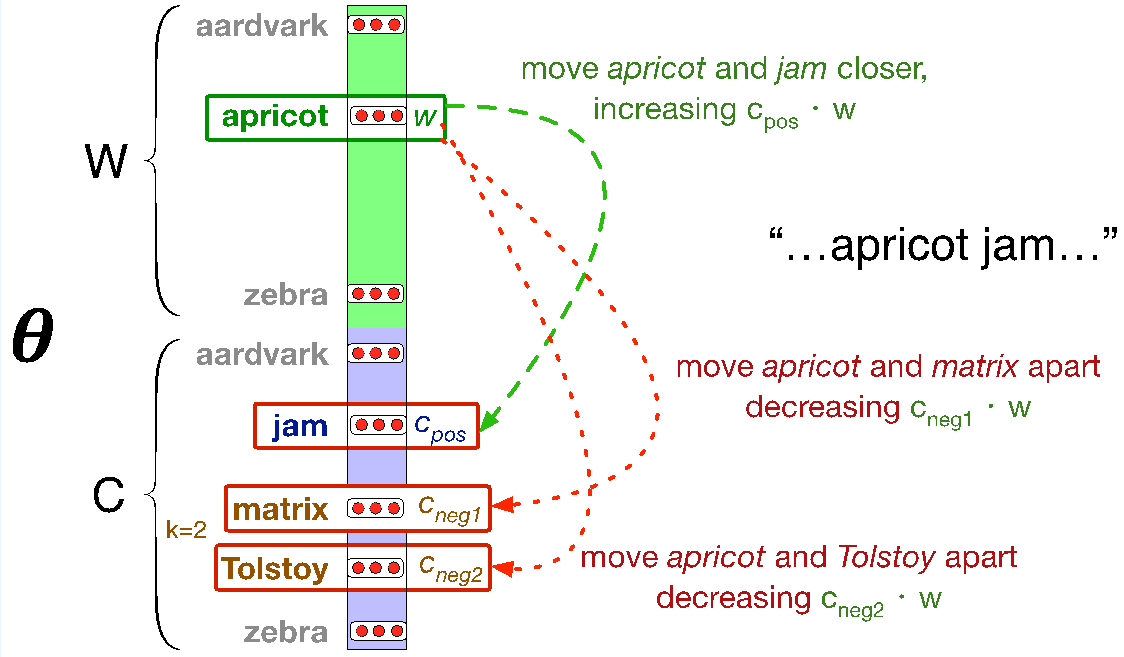

如果在这一节前你阅读过《自然语言处理--文本分类》,那应该对特征向量有印象,我们将一段文本转化为一段向量,维度i的值便是文本位置i上的单词的统计词频。同样的,我们也希望能把每个单词转化为向量,用于表示这个单词的词义,这就是我们常说的“词向量(Word embedding)“。我们按照某种规则,将词义映射到一个向量空间上,每个词转化为了空间中的一个向量,这种操作被称为“词嵌入”。而这一切的原理都来自一个假设:词义相近的词,它们的上下文也是相似的。

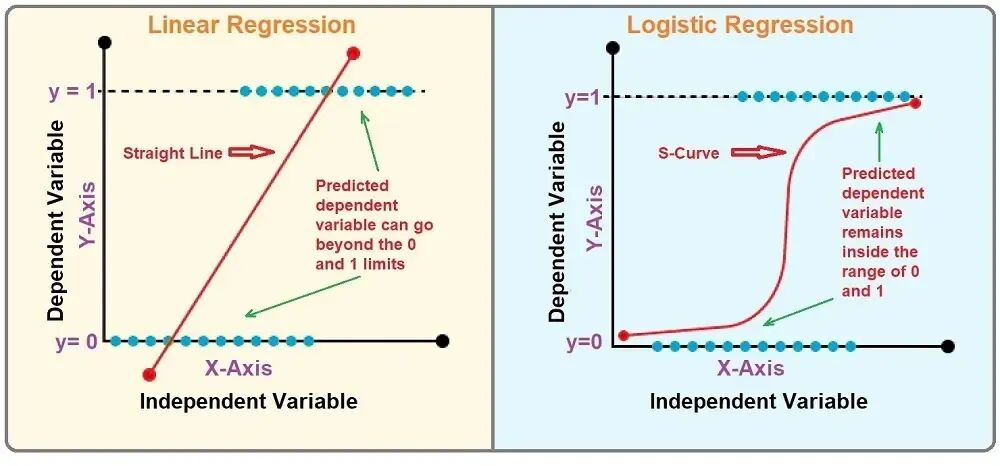

摘要:向量语义学,词-文共生矩阵,词-词共生矩阵,向量相似度量与余弦度量,TF-IDF词向量,Word2vec词向量,Skip-gram模型